Para facilitar la planificación de recuperación de backups, hemos desarrollado una calculadora que te permite ingresar el tamaño del respaldo y la velocidad del enlace. Con estos datos, podrás estimar de manera precisa el tiempo requerido para la descarga de tus respaldos.

Esta calculadora de tiempo de descarga considera el valor mínimo teorico en que se puede descargar un respaldo de la nube a través de Internet, considerando:

- La eficiencia de TCP/IP con IPV4 de 90% debida a la sobrecarga de los encabezados.

- Una eficiencia del 90% debida a la sobrecarga del protocolo de seguridad utilizado.

- Al ser una descarga por Internet se considera un MTU de 1500

- No considera congestiones, ni problemas de latencia.

Factores que afectan la descarga de un backup desde la nube

Muchas empresas dependen de la nube para almacenar respaldos de información crítica. Sin embargo, cuando se requiere recuperar un backup de gran tamaño, pueden surgir problemas inesperados que impactan en los tiempos de descarga y, en consecuencia, en la continuidad de la operación. Comprender los factores que influyen en la velocidad de descarga es clave para gestionar los tiempos de restauración y evitar interrupciones en la operación.

1. Ancho de banda disponible

El primer elemento a considerar es el ancho de banda del enlace de Internet utilizado para la descarga. Un enlace de 100 Mbps, por ejemplo, no significa que toda esa capacidad esté disponible exclusivamente para la recuperación del backup, ya que existen otras aplicaciones y servicios consumiendo ancho de banda simultáneamente.

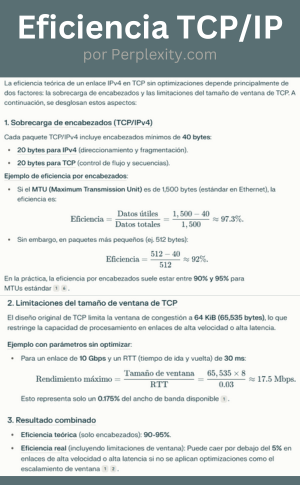

2. Eficiencia de TCP/IP

La eficiencia del protocolo TCP/IP reduce la capacidad efectiva de transmisión debido a la sobrecarga de encabezados. Los encabezados TCP tienen un tamaño mínimo de 20 bytes. Los encabezados IP varían: 20 bytes en IPv4 y 40 bytes en IPv6. Esta sobrecarga disminuye la eficiencia al aumentar el tamaño total de los paquetes. Además, en Internet se considera un MTU máximo de 1500 bytes. A diferencia de los enlaces privados LAN-to-LAN, donde es posible utilizar ‘jumbo frames’ para incrementar el payload y mejorar la eficiencia, en Internet público no es posible modificar dicho valor. Es importante notar que el uso de ‘jumbo frames’ requiere que todos los dispositivos en la ruta de comunicación los soporten, limitando su implementación principalmente a LANs controladas. Otros factores como la congestión de la red, la pérdida de paquetes y la latencia también influyen en la eficiencia general de TCP/IP.

La siguiente imagen explica el calculo teorico para la eficiancia de IP

3. Cifrado y sobrecarga de IPSec

Las conexiones cifradas, mediante protocolos como IPSec y TLS, introducen una sobrecarga adicional que reduce el rendimiento del enlace. Esta sobrecarga puede variar significativamente, oscilando entre un 5% y un 25%, dependiendo de factores como el algoritmo de cifrado utilizado (por ejemplo, AES o 3DES), el modo de operación del protocolo (túnel o transporte) y la capacidad de procesamiento del hardware de cifrado. En escenarios donde se utilizan algoritmos de cifrado complejos y hardware de baja capacidad, la sobrecarga puede acercarse al 25%. Por otro lado, con algoritmos optimizados y hardware de alto rendimiento, la sobrecarga podría mantenerse cercana al 5%. Como resultado, el ancho de banda efectivo se reduce, afectando la velocidad de transmisión de datos.

4. Congestión en dispositivos intermedios

Un factor crítico en la descarga de backups es el impacto en dispositivos como ruteadores y firewalls. Estos equipos no solo deben manejar la carga habitual de la operación, sino que también procesan el tráfico adicional generado por la restauración del backup. Esta carga adicional puede manifestarse de diversas maneras:

- Aumento en el procesamiento de paquetes: Cada paquete de datos del backup debe ser inspeccionado y enrutado, lo que consume recursos de CPU y memoria en los dispositivos.

- Inspección profunda de paquetes (DPI) en firewalls: Los firewalls modernos realizan DPI para analizar el contenido del tráfico en busca de amenazas. Esta inspección es aún más intensiva en recursos durante una restauración de backup, ya que se procesa un gran volumen de datos.

- Traducción de direcciones de red (NAT): Si el backup se restaura a una red interna, los ruteadores y firewalls deben realizar NAT para traducir las direcciones IP. Esto añade una carga adicional, especialmente si se manejan grandes volúmenes de tráfico.

- Gestión de sesiones: Los firewalls mantienen el estado de las conexiones (sesiones). Una restauración de backup puede generar un gran número de nuevas sesiones, lo que puede sobrecargar la capacidad de gestión de sesiones del firewall.

- Micro picos de demanda: Durante la transferencia de grandes cantidades de datos, es común que se produzcan micro picos de demanda, los cuales pueden saturar de manera temporal estos dispositivos.

Si estos dispositivos están cerca de su capacidad máxima de procesamiento, la transferencia de datos puede verse afectada de múltiples formas:

- Latencia aumentada: El tiempo que tardan los paquetes en ser procesados y enrutados aumenta, lo que ralentiza la transferencia de datos.

- Pérdida de paquetes: Los buffers de los dispositivos pueden llenarse, lo que provoca la pérdida de paquetes y la necesidad de retransmisiones.

- Variación en la velocidad de transferencia: La velocidad de descarga puede fluctuar, lo que dificulta la estimación del tiempo total de restauración.

- Cuellos de botella: Los dispositivos saturados pueden convertirse en cuellos de botella, limitando el ancho de banda efectivo disponible para la restauración del backup.

Ejemplo de cálculo: Descargando un backup de 5 TB

Si consideramos un enlace de 100 Mbps con una eficiencia de TCP/Ethernet del 90% y una sobrecarga de IPSec del 10%:

- Capacidad base: 100 Mbps.

- Eficiencia TCP/Ethernet: 100 Mbps * 90% = 90 Mbps.

- Impacto de IPSec: 90 Mbps * (1 – 10%) = 81 Mbps.

Ahora, convirtiendo 5 TB a bits:

- 5 TB = 5 * 1024 GB = 5120 GB.

- 5120 GB * 8 (para convertir a bits) = 40,960 Gbps.

- 40,960 Gbps / 81 Mbps = 505432.10 segundos.

- 505432.10 segundos / 3600 = aproximadamente 140.4 horas (casi 5.85 días).

Este tiempo puede ser mayor si existen otros consumos en el enlace o congestión en los dispositivos de red. Además, no se consideran retransmisiones por latencia, las cuales en algunos casos pueden ser significativas y afectar aún más el tiempo total de descarga.

Optimización y planificación

Para mitigar estos tiempos de recuperación, las empresas pueden:

- Evaluar si su ancho de banda es suficiente para procesos de recuperación críticos, ya que esto impacta directamente en el Recovery Time Objective (RTO). Un RTO más estricto requiere una recuperación más rápida, lo que implica que el ancho de banda y la priorización del tráfico sean adecuados para minimizar el tiempo de restauración.

- Implementar soluciones de optimización de tráfico y QoS en firewalls y routers. Además, es recomendable detener el tráfico no crítico, como actualizaciones automáticas y navegación web no esencial, durante la descarga del backup para priorizar el uso del ancho de banda en la recuperación de datos.

- Considerar el uso de servicios de recuperación en la nube con opciones de entrega física de datos, aunque es importante señalar que la disponibilidad de estos servicios varía según el país. Por ejemplo, en Estados Unidos, Azure ofrece soluciones de entrega física de datos para agilizar la recuperación, mientras que en México este servicio aún no está disponible.

- Simular restauraciones de backups en un entorno de prueba para identificar posibles cuellos de botella y ajustar la configuración de los dispositivos.

- Asegurarse de que los ruteadores y firewalls tengan suficiente capacidad de procesamiento para manejar la carga adicional.

Conclusión

Esperamos que esta explicación e te haya sido de utilidad. Comprender la influencia del ancho de banda, la eficiencia de transmisión y la congestión de red es clave para mejorar los tiempos de recuperación de datos y evitar interrupciones operativas.

Si bien no siempre es posible reducir el tiempo de descarga de un backup, la planificación y la optimización del tráfico pueden marcar la diferencia en escenarios críticos.

¡Gracias por leer! Si tienes dudas o sugerencias, no dudes en compartirlas con nosotros.

- Calculadora RAID online - marzo 15, 2025

- Calculadora EPS a GB/día - marzo 13, 2025

- Comprobador de Contraseñas - marzo 11, 2025